har vist frem et kunstig intelligenssystem som kan lage bilder basert på tekstinntasting. Tanken er at brukere kan skrive inn hvilken som helst beskrivende tekst, og AI vil gjøre det om til et bilde. Selskapet sier opprettet av Brain Team hos Google Research, tilbyr “en enestående grad av fotorealisme og et dypt nivå av språkforståelse.”

Dette er ikke første gang vi har sett AI-modeller som dette. (og ) genererte både overskrifter og bilder på grunn av hvor godt det kan gjøre tekst om til visuelle elementer. Googles versjon prøver imidlertid å lage mer realistiske bilder.

For å vurdere Imagen mot andre tekst-til-bilde-modeller (inkludert DALL-E 2, VQ-GAN+CLIP og Latent Diffusion Models), laget forskerne en benchmark kalt . Det er en liste over 200 tekstmeldinger som ble lagt inn i hver modell. Menneskelige vurderinger ble bedt om å vurdere hvert bilde. De “foretrekker Imagen fremfor andre modeller i side-ved-side-sammenligninger, både når det gjelder prøvekvalitet og bilde-tekstjustering,” sa Google.

Det er verdt å merke seg at eksemplene vist på er kuratert. Som sådan kan disse være de beste av de beste bildene som modellen har laget. De gjenspeiler kanskje ikke det meste av det visuelle som det genererte nøyaktig.

I likhet med DALL-E er ikke Imagen tilgjengelig for publikum. Google tror foreløpig ikke er egnet for bruk av den generelle befolkningen av en rekke årsaker. For det første er tekst-til-bilde-modeller typisk trent på store datasett som er skrapet fra nettet og ikke er kurert, noe som introduserer en rekke problemer.

“Selv om denne tilnærmingen har muliggjort raske algoritmiske fremskritt de siste årene, gjenspeiler datasett av denne art ofte sosiale stereotyper, undertrykkende synspunkter og nedsettende, eller på annen måte skadelige, assosiasjoner til marginaliserte identitetsgrupper,” skrev forskerne. “Mens en delmengde av treningsdataene våre ble filtrert for å fjerne støy og uønsket innhold, som pornografiske bilder og giftig språk, brukte vi også LAION-400M-datasettet, som er kjent for å inneholde et bredt spekter av upassende innhold, inkludert pornografiske bilder, rasistiske utsagn. og skadelige sosiale stereotyper.”

Som et resultat, sa de, har Imagen arvet “sosiale skjevheter og begrensningene til store språkmodeller” og kan skildre “skadelige stereotypier og representasjon.” Teamet sa at foreløpige funn indikerte at AI koder for sosiale skjevheter, inkludert en tendens til å lage bilder av mennesker med lysere hudtoner og plassere dem i visse stereotype kjønnsroller. I tillegg bemerker forskerne at det er potensial for misbruk hvis Imagen ble gjort tilgjengelig for allmennheten som den er.

Teamet kan til slutt tillate publikum å legge inn tekst i en versjon av modellen for å generere sine egne bilder. “I fremtidig arbeid vil vi utforske et rammeverk for ansvarlig eksternalisering som balanserer verdien av ekstern revisjon med risikoen for ubegrenset åpen tilgang,” skrev forskerne.

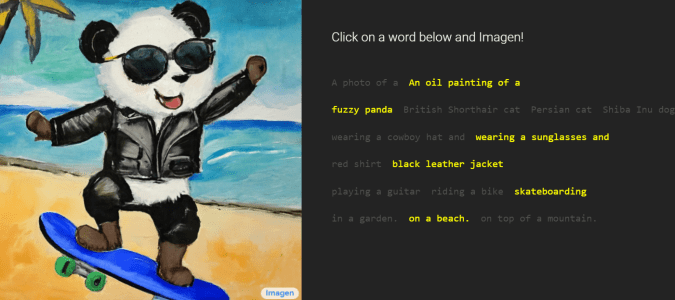

Du kan imidlertid prøve Imagen på en begrenset basis. På , kan du lage en beskrivelse ved å bruke forhåndsvalgte fraser. Brukere kan velge om bildet skal være et bilde eller et oljemaleri, hva slags dyr som vises, klærne de har på seg, handlingen de utfører og innstillingen. Så hvis du noen gang har ønsket å se en tolkning av et oljemaleri som viser en uklar panda med solbriller og en svart skinnjakke mens du skateboard på en strand, her er sjansen din.

Google Research

Alle produkter anbefalt av Engadget er valgt ut av redaksjonen vår, uavhengig av vårt morselskap. Noen av historiene våre inkluderer tilknyttede lenker. Hvis du kjøper noe gjennom en av disse lenkene, kan vi tjene en tilknyttet provisjon.